Facebook, Instagram y YouTube han evolucionado a un modelo de enganche, un opiáceo digital que tiene repercusiones, sobre todo, en los niños, adolescentes y jóvenes. Así lo reconoce ya, incluso, la justicia

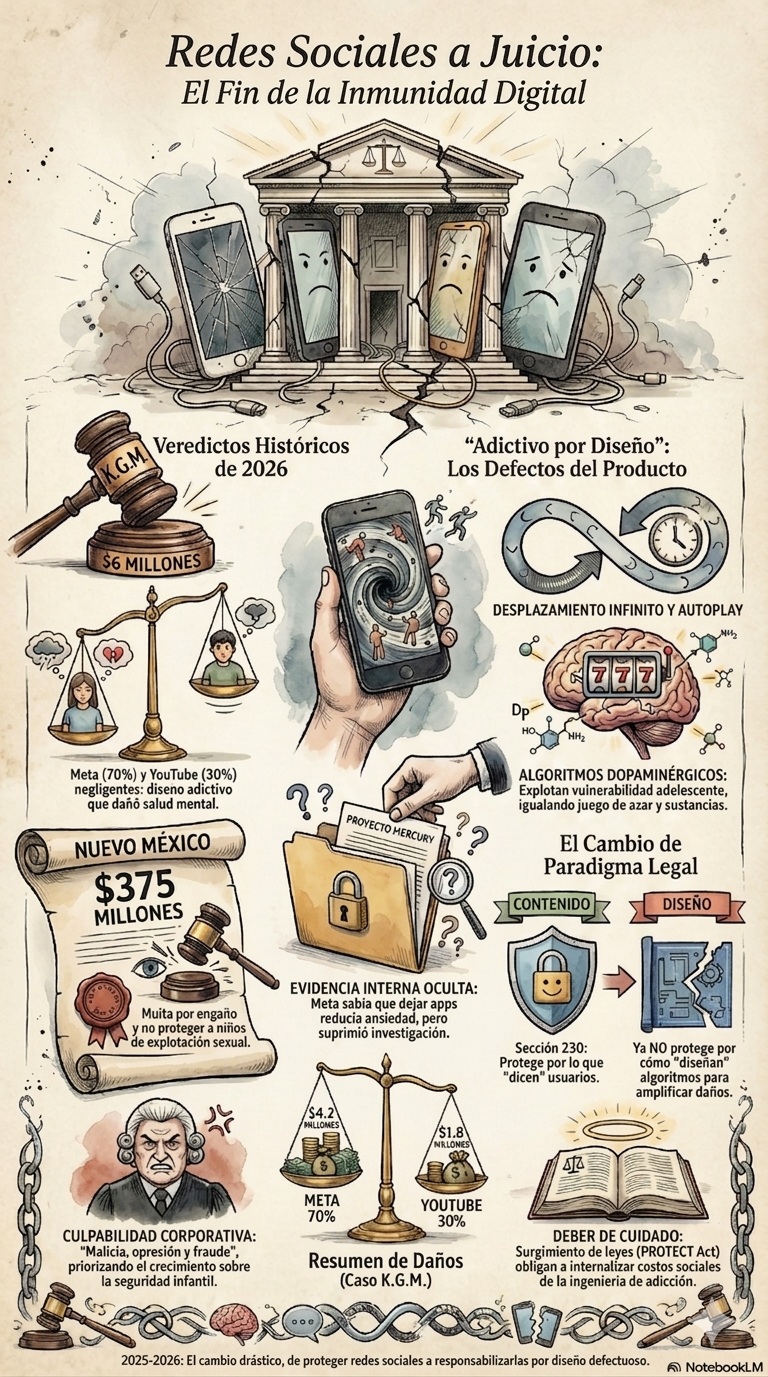

Las decisiones siempre marcan puntos de inflexión. Y algunas tomadas recientemente podrían ser el parteaguas de la industria tecnológica que se dedica a las redes sociales digitales. Resulta que un jurado de la Corte Superior de Los Ángeles emitió, el 27 de marzo último, un veredicto que obliga a pagar seis millones de dólares a Meta (propietaria de Instagram y Facebook) y YouTube, por el diseño adictivo de sus redes sociales.

La sentencia se produjo apenas un día después de que Meta fuera condenada a pagar 375 millones de dólares en multas civiles en una demanda aparte en Nuevo México. En ese caso, el jurado determinó que la empresa engañó a los consumidores sobre la seguridad de sus plataformas y propició perjuicios a sus usuarios, incluyendo la explotación sexual infantil.

Aunque el monto de dinero es apenas un rasguño para estos gigantes de la tecnología que cada año amasan miles de millones de dólares en ganancias, los fallos no se pueden pasar por alto. En primer lugar, porque determinan que ambas compañías fueron negligentes al diseñar plataformas que fomentan de manera deliberada la adicción en menores de edad, provocando graves daños en su salud mental.

La salud mental en menores asociada con las redes digitales no es algo nuevo, pero, según afirma The Legal Examiner, el caso de Los Ángeles es el primero de su tipo que llega a un juicio, estableciendo que las empresas tecnológicas pueden ser legalmente responsables bajo las leyes que sancionan por la creación de productos defectuosos.

El referido caso se centró en una joven demandante identificada como K.G.M., de 20 años de edad, que comenzó a usar YouTube a los seis años, e Instagram a los nueve (la edad legal que establecen estas plataformas es de 13 años, mínimo), y aquí hago el paréntesis por la evidente falta de responsabilidad parental.

Según la evidencia presentada, el uso compulsivo de estas plataformas por parte de la joven —que llegaba a las 16 horas diarias— contribuyó a que desarrollara depresión severa, ansiedad, dismorfia corporal e ideación suicida. El jurado asignó el 70 por ciento de la responsabilidad a Meta y el 30 por ciento a YouTube, otorgando tres millones en daños compensatorios y otros tres millones en daños punitivos, tras hallar que las empresas actuaron con malicia, opresión y fraude.

Este fallo puede considerarse como un giro tectónico en el panorama jurídico internacional. La justicia ya no ve a las redes sociales como conductos neutrales de información, sino como productos manufacturados para explotar la vulnerabilidad neurobiológica de los menores. Anteriormente, los casos legales solían fracasar al intentar culpar a las plataformas por lo que otros publicaban; sin embargo, esta nueva estrategia legal se enfoca en la ingeniería del producto.

De acuerdo con el blog especializado en leyes de la Universidad de Cincinnati, en Estados Unidos, este cambio de paradigma permite que las aplicaciones sean juzgadas con los mismos estándares que un vehículo con frenos defectuosos. Al tratar el diseño algorítmico como una conducta procesable y no como un discurso protegido, los tribunales responden a la evolución tecnológica y buscan que las corporaciones no utilicen leyes obsoletas para evadir su responsabilidad por prácticas que dañan el desarrollo cerebral de niños y adolescentes.

La clave legal para superar la inmunidad que las tecnológicas han disfrutado durante décadas reside en la distinción entre contenido y diseño. En el caso de Estados Unidos, según explica la publicación Lawfare, la Sección 230 de la Ley de Decencia en las Comunicaciones, promulgada en 1996, protege a las plataformas de ser tratadas como el «editor» del contenido generado por terceros. No obstante, los jueces en California, y otros estados, han dictaminado que esta inmunidad no aplica cuando el daño proviene de la arquitectura interna de la aplicación.

La diferencia es fundamental: la responsabilidad por contenido se refiere a lo que un usuario publica (por ejemplo, un mensaje de odio), mientras que la responsabilidad por diseño se relaciona con funciones creadas por la empresa, tales como el desplazamiento infinito (conocido como el scroll de la muerte), la reproducción automática de videos y las notificaciones push invasivas. Estas características tienen un comportamiento similar al de las máquinas tragamonedas, diseñadas para atrapar la atención mediante bucles de dopamina, lo cual constituye un defecto de diseño independiente de cualquier mensaje específico que aparezca en pantalla.

Uno de los puntos más impactantes del juicio fue la desclasificación de documentos internos que muestran que los ejecutivos de las tecnológicas conocían los riesgos. Investigaciones internas de Meta, como el Proyecto Mercury, hecha en 2020, revelaron que los usuarios que dejaban de usar Facebook e Instagram por una semana reportaban niveles significativamente menores de depresión y ansiedad. Sin embargo, la empresa decidió no publicar estos hallazgos para no afectar sus métricas de crecimiento, reportó The Guardian.

Otras comunicaciones internas revelaron un nivel de cinismo alarmante entre los empleados de Meta. En correos electrónicos, una investigadora admitió que «Instagram es una droga», a lo que otro empleado respondió: «Somos básicamente traficantes».

Estos documentos prueban que Meta priorizó maximizar el «tiempo de permanencia de los adolescentes», como su principal métrica de éxito, a pesar de las advertencias de sus propios equipos de seguridad sobre los efectos nefastos de los algoritmos en los cerebros en desarrollo.

Infografía generada con IA bajo supervisión del autor.

El dictamen de California es solo el comienzo de una cadena de juicios pendientes contra las redes sociales. Existen más de 2 400 casos en litigio solo en el norte del estado, y, se concentran allí, porque, en este territorio, tienen sus sedes la mayoría de las grandes tecnológicas. Los juicios comenzarán en junio.

Ese flujo masivo de demandas probablemente forzará a las empresas a negociar acuerdos globales multimillonarios para evitar fallos punitivos similares a los que acaban de ocurrir.

En el ámbito legislativo, la presión judicial podría acelerar reformas que buscan prohibir funciones adictivas para menores de 16 años y establecer un «deber de cuidado» obligatorio para las plataformas. Así, el futuro legal apunta a una industria tecnológica obligada a internalizar sus costos sociales, donde el diseño algorítmico no sea considerado como algo «natural», sino como una herramienta de ingeniería con profundas consecuencias neurológicas que la ley debe supervisar rigurosamente.

Infografía generada con IA bajo supervisión del autor.